Kuulates Ajus ‘Kokteilipeo efekti’

Mõned inimesed saavad keskenduda ühele kõnelejale vaatamata ümbritsevale keskkonnale, mis varjab inimese häält. Tegevuskohaks võib olla klassiruum, baar või spordiüritus - võime pole ainulaadne ja psühholoogid on seda kirjeldanud kui "kokteilipeo efekti".

Uus uurimistöö, mida juhtis California ülikool - San Francisco neurokirurg ja järeldoktor, keskendus uurimisele, kuidas selektiivne kuulmine ajus toimib.

Edward Chang, MD, ja Nima Mesgarani, Ph.D., töötasid kolme patsiendiga, kellele tehti raske epilepsia tõttu ajuoperatsioon.

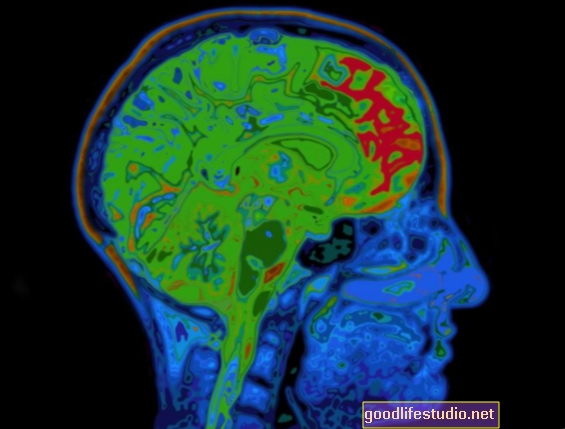

Osa sellest operatsioonist hõlmab krampide blokeerimise eest vastutavate ajuosade täpsustamist. See harjutus hõlmab aju aktiivsuse kaardistamist nädala jooksul, aju välispinnale või ajukoorele kolju alla asetatud õhuke kuni 256 elektroodiga leht. Elektroodid registreerivad aktiivsust temporaalsagaras - kuulmiskoore kodus.

Chang ütles, et võime koljusiseseid salvestisi ohutult salvestada andis ainulaadsed võimalused põhiteadmiste edendamiseks aju toimimisest.

"Kõrglahutusega ajusalvestiste ja võimsate dekodeerimisalgoritmide kombinatsioon avab akna vaimu subjektiivsele kogemusele, mida me pole kunagi varem näinud," ütles Chang.

Katsetes kuulasid patsiendid kahte samaaegselt mängitud kõneproovi, milles erinevad kõnelejad rääkisid erinevaid fraase. Neil paluti tuvastada sõnad, mida nad kuulsid, rääkides kahest kõnelejast.

Seejärel rakendasid autorid uusi dekodeerimismeetodeid, et “rekonstrueerida” katsealused oma aju aktiivsuse mustrite analüüsimisel.

Üllataval kombel leidsid autorid, et kuulmiskoores esinevad närvivastused peegeldasid ainult sihtrühma kõneleja vastuseid. Nad leidsid, et nende dekodeerimisalgoritm suudab nende närvimustrite põhjal ennustada, millist kõnelejat ja isegi konkreetseid sõnu subjekt kuulas. Teisisõnu võiksid nad öelda, kui kuulaja tähelepanu hajus teise kõneleja poole.

"Algoritm töötas nii hästi, et me oskasime ennustada mitte ainult õigeid vastuseid, vaid ka siis, kui nad valele sõnale tähelepanu pöörasid," ütles Chang.

Uued leiud näitavad, et kõne kujutamine ajukoores ei peegelda ainult kogu välist akustilist keskkonda, vaid hoopis seda, mida me tegelikult tahame või peame kuulma.

Need kujutavad endast suurt edasiminekut selle mõistmisel, kuidas inimese aju keelt töötleb, millel on otsene mõju vananemise, tähelepanuhäire, autismi ja keeleõppe häirete uurimisele.

Lisaks ütleb Chang, et võime kunagi seda tehnoloogiat kasutada neuroproteetiliste seadmete jaoks, et dekodeerida halvatud patsientide kavatsused ja mõtted, kes ei saa suhelda.

Mõistmine sellest, kuidas meie aju on ühendatud, et eelistada mõnda kuulmisviisi teistele, võib julgustada uusi lähenemisviise häälkäskluste korraliku tuvastamise automatiseerimiseks ja parandamiseks, kuidas häälega aktiveeritavad elektroonilised liidesed helisid filtreerivad.

Meetod, mille abil aju saab nii tõhusalt keskenduda ühele häälele, on märkimisväärselt huvipakkuv ettevõtetele, kes arendavad häälaktiivsete liidestega elektroonilisi seadmeid.

Ehkki kõnetuvastustehnoloogiad, mis võimaldavad selliseid liideseid nagu Apple'i Siri, on viimase paari aasta jooksul kaugele jõudnud, pole need kaugeltki nii keerukad kui inimese kõnesüsteem. Näiteks võib keskmine inimene kõndida lärmakasse tuppa ja pidada privaatset vestlust suhteliselt hõlpsalt - nagu oleksid kõik ülejäänud hääled toas vaigistatud.

Kõnetuvastus, ütles automaatse kõnetuvastuse uurimise taustaga insener Mesgarani, on "miski, milles inimesed on silmapaistvalt head, kuid tuleb välja, et selle inimvõime masinlik jäljendamine on äärmiselt keeruline".

Uurimisartikkel ilmub ajakirjas Loodus.

Allikas: California ülikool, San Francisco (UCSF)